Actualités SEO, GEO & IA : 6 avril – 12 avril 2026

Résumé IA

Cet article résume les mutations de l'industrie du 6 avril au 12 avril 2026, centrées sur la transition vers l'IA. Quentin Yacoub y décrypte les nouveaux classifieurs shopping de Google, la visibilité des domaines sur GPT-5.4 et les stratégies 'Search Everywhere'. Ce condensé offre des pistes concrètes pour naviguer à l'ère du commerce agentique et de la découverte via les LLM.

Table des matières

This article is also available in English: SEO, GEO & AI News: April 6th – April 12th, 2026

Actualités très denses encore cette semaine. Entre les analyses SEO, la hype du GEO et les nouveaux outils qui n’en finissent plus d’arriver grâce aux assistants de code IA, ça fait beaucoup de choses à suivre !

Ce condensé devrait te permettre de gagner du temps et d’aller directement vers la partie qui t’intéresse. Si je ne devais retenir qu’une ressource, ce serait le guide sur les 12 facteurs de classement LLM en 2026, qui est très complet et donne une vue d’ensemble des stratégies disponibles pour améliorer sa visibilité sur les LLMs.

Un retour sur ces actualités ? Retrouvez-moi sur LinkedIn.

Actualités SEO

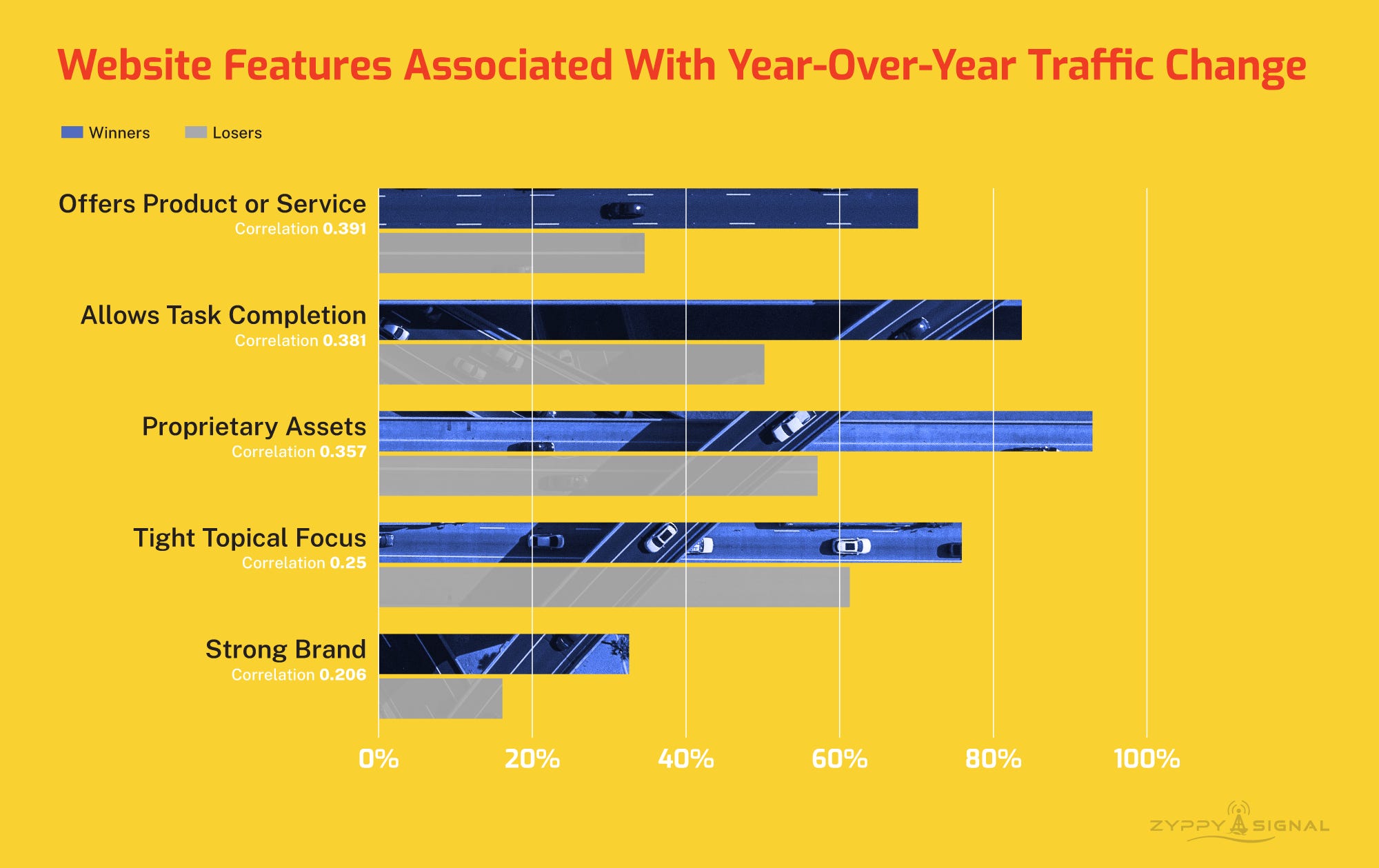

5 caractéristiques des sites web qui gagnent sur Google en 2026

Cyrus Shepard identifie cinq traits communs aux sites performants : proposer un produit ou service propre, permettre la réalisation de tâches, posséder des actifs exclusifs, maintenir une expertise thématique ciblée et bâtir une marque forte. Cette analyse démontre que Google privilégie désormais les sites offrant une utilité unique et une autorité réelle dépassant le simple contenu informatif.

Le contenu IA ranke-t-il vraiment ?

Une analyse de Semrush analyse les performances de classement du contenu IA par rapport au contenu humain en passant 42 000 pages de blog dans l'outil GPTZero. L'étude révèle que les pages rédigées par des humains ont 8 fois plus de chances d'occuper la première place. Les conclusions suggèrent que si l'IA accélère la production, les moteurs de recherche récompensent systématiquement l'originalité humaine aux plus hauts niveaux de performance.

Lire l'étude Semrush (non traduit)Rétro-ingénierie du nouveau classifieur Shopping de Chrome

Dan Petrovic3 avril 2026Dan Petrovic et Olivier de Segonzac ont rétro-conçu un nouveau modèle Google Chrome capable d'identifier si un utilisateur consulte une page de vente. Ce classement permet à Google de personnaliser l'expérience utilisateur et les recommandations en fonction des métadonnées de navigation. Le système repose sur un pipeline restrictif qui n'analyse que les quelques centaines premiers mots du contenu d'une page.

Explorer le modèle (non traduit)Pourquoi c'est important: Les éléments techniques comme des menus volumineux ou des bannières de cookies peuvent empêcher le modèle d'identifier les données produits, et si Chrome ne parvient pas à reconnaître une page, les utilisateurs seront privés des outils de commerce automatisés. Pour rester détectable, je recommande de s'assurer que les principaux signaux d'achat sont placés tôt dans le contenu.

Google règle un bug des impressions de plus d'un an dans la GSC

Google a lancé un correctif pour une erreur de tracking dans la Search Console qui a surestimé le nombre d'impressions du 13 mai 2025 au 3 avril 2026. Alors que cette correction se déploie dans les prochaines semaines, les propriétaires de sites constateront une baisse des impressions signalées alors que les performances réelles et les données de clics restent inchangées.

Lire l'article complet (non traduit)Pourquoi c'est important: Si tes impressions chutent dans les semaines à venir, pas de panique, ça représente un retour à la précision des données et non une baisse de performance. Ce correctif me fait penser que les baisses récentes du CTR résultaient probablement d'une combinaison de gonflement technique et pas seulement de la présence des AI Overviews.

Actualités GEO

Évolution de la visibilité avec GPT-5.3/5.4

Une étude de Resoneo révèle une baisse de 20 % des domaines uniques cités par réponse dans ChatGPT Search depuis le passage à GPT-5.3 et 5.4. Alors que la profondeur de crawl reste stable, les modèles privilégient désormais les domaines à forte autorité au détriment des sites intermédiaires, rappelant l'effet « Bigfoot ». Cette évolution réduit considérablement la surface de visibilité pour la majorité des sites web.

Pourquoi c'est important: Ces données valident les observations de Chris Long (voir édition précédente) selon lesquelles ChatGPT utilise désormais des opérateurs site: pour contourner les comparateurs tiers. Ce changement impose de pivoter vers le renforcement de l'autorité directe du domaine plutôt que de dépendre de la visibilité offerte par des intermédiaires

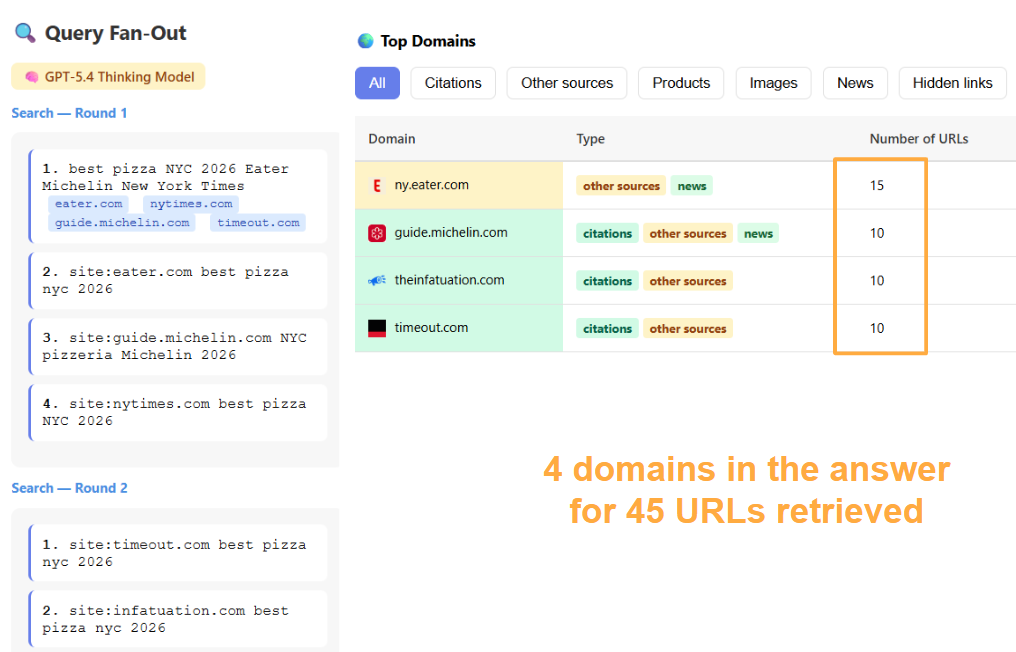

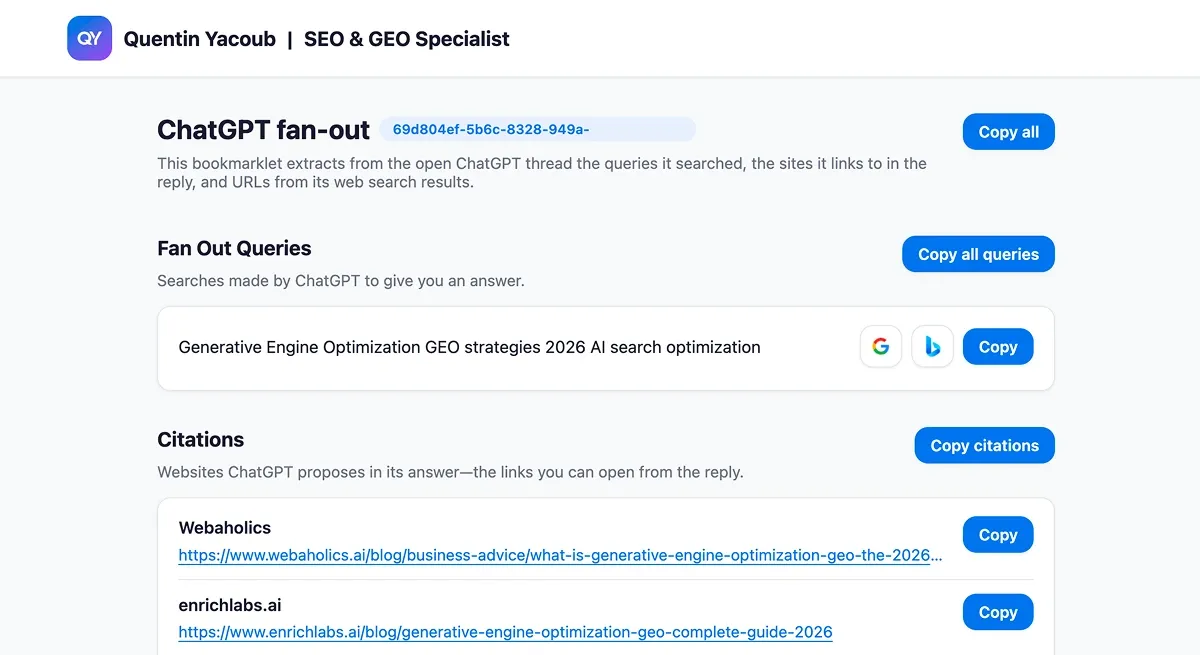

Découvrir les recherches cachées de ChatGPT

Chris Long9 avril 2026Chris Long a partagé sur LinkedIn le retour des « fan-out queries » dans ChatGPT, permettant aux SEO de suivre les termes de recherche masqués utilisés par le modèle. J'ai créé un raccourci chrome pour simplifier l'extraction de ces données depuis n'importe quelle conversation. Si tu veux faire à la même en masse et sur n'importe quel LLM, LLM Optimizer est fait pour ça

Voir le post sur LinkedIn (non traduit)Pourquoi c'est important: Ces requêtes nous permettent de suivre les mots clés organiques utilisés pour les résultats de l'IA, d'identifier les sources influentes et de repérer les lacunes de contenu.

Analyse du trafic ChatGPT

Semrush a analysé 17 mois de données, révélant que le referral traffic sortant de ChatGPT a bondi de 206 % en 2025, alors que son trafic total stagne autour du milliard de visites mensuelles. Bien que seulement 34,5 % des requêtes déclenchent actuellement une recherche web en direct, la plateforme s'impose comme un point d'entrée critique pour les marques.

Lire l'analyse complète (non traduit)Pourquoi c'est important: Ces statistiques confirment le virage vers la recherche via LLM. À mon sens, le GEO n'est plus une option pour les marques ; c'est désormais un impératif pour maintenir leur visibilité numérique dans ce nouveau paysage.

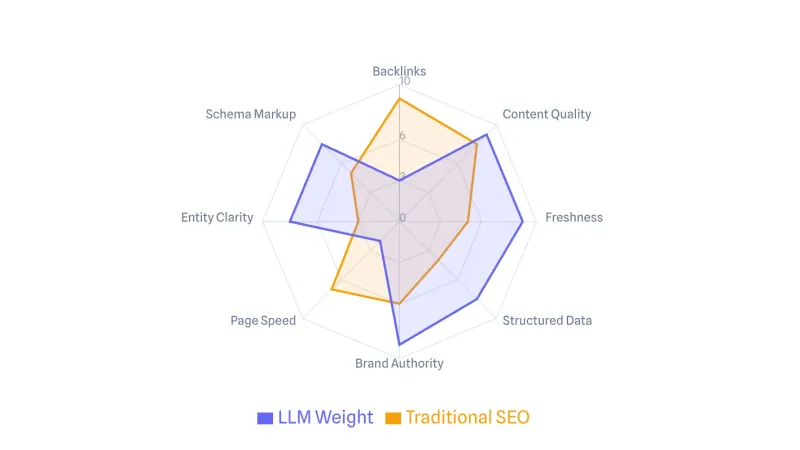

12 facteurs de classement LLM en 2026

AISO7 avril 2026Ce guide détaille 12 facteurs de visibilité sur les LLMs: correspondance de requête, fraîcheur, profondeur, réponses directes, données structurées, clarté des entités, hiérarchie des titres, stats/citations, tableaux/listes, autorité thématique, volume de recherche de marque et présence multiplateforme.

Explorer les 12 facteurs de classementPourquoi c'est important: Cet article propose une stratégie pour faire la transition entre le SEO traditionnel et le GEO

Comment intégrer l'Universal Commerce Protocol (UCP)

Google Support8 avril 2026Google a publié un guide d'intégration pour l'Universal Commerce Protocol (UCP) afin de permettre le paiement natif via l'IA sur Gemini et Google Search. Le processus nécessite une mise en œuvre technique préalable et le remplissage d'un formulaire d'intérêt avant de pouvoir accéder à un environnement de test au sein du Merchant Center.

Lire le guide d'intégration UCPPourquoi c'est important: Alors que ChatGPT a récemment mis de côté sa fonctionnalité Instant Checkout (voir édition précédente), l'impulsion de Google pour l'UCP confirme que l'industrie s'oriente résolument vers le commerce agentique.

Citations par l'IA : l'échec du robots.txt pour protéger les médias

BuzzStream28 mars 2026Une analyse de 4 millions de citations sur les médias révèle que les directives standard du fichier robots.txt échouent à empêcher les modèles d'IA de citer les contenus. Malgré ces restrictions, 70,6 % des sites bloquant les robots de récupération et 92,3 % bloquant les robots d'entraînement sont toujours cités. Cela suggère que les modèles contournent les règles de crawl ou utilisent l'extraction des SERP, des archives tierces comme Common Crawl et des jeux de données existants.

Lire l'étude complète sur les crawlers d'IAPourquoi c'est important: 1. Tout site souhaitant réellement restreindre l'accès de l'IA devrait appliquer le blocage au niveau de l'hébergeur ou au CDN pour garantir le respect de la directive. 2. C'est aussi un rappel que nous devons désormais auditer les règles de crawl des éditeurs avant d'investir dans du PR, car un backlink provenant d'un site qui bloque efficacement l'IA n'aura aucun impact sur votre visibilité dans les LLM et les résultats GEO.

ChatGPT (GPT 5.4) privilégie les domaines en .com dans son processus de query fan-out

Chris Long7 avril 2026Chris Long identifie un nouveau comportement chez GPT 5.4, où le modèle utilise l'opérateur site:.com lors de l'expansion de requêtes pour prioriser le contenu provenant de certains domaines de premier niveau. Cette découverte suggère que les LLM pourraient de plus en plus considérer l'extension .com comme un signal de confiance majeur lors de la recherche d'informations faisant autorité.

Lire le post LinkedIn completPourquoi c'est important: 1. Sa recherche s'est concentrée sur une localisation aux États-Unis. Je soupçonne que ChatGPT pourrait adapter ce comportement à d'autres régions en privilégiant des TLD locaux comme .ca ou .fr. 2. Cela pourrait signifier que les extensions modernes comme .ai ou .co perdraient en visibilité. Ça mérite une étude à plus grande échelle pour mesurer l'ampleur de ce biais.

Actualités Adobe

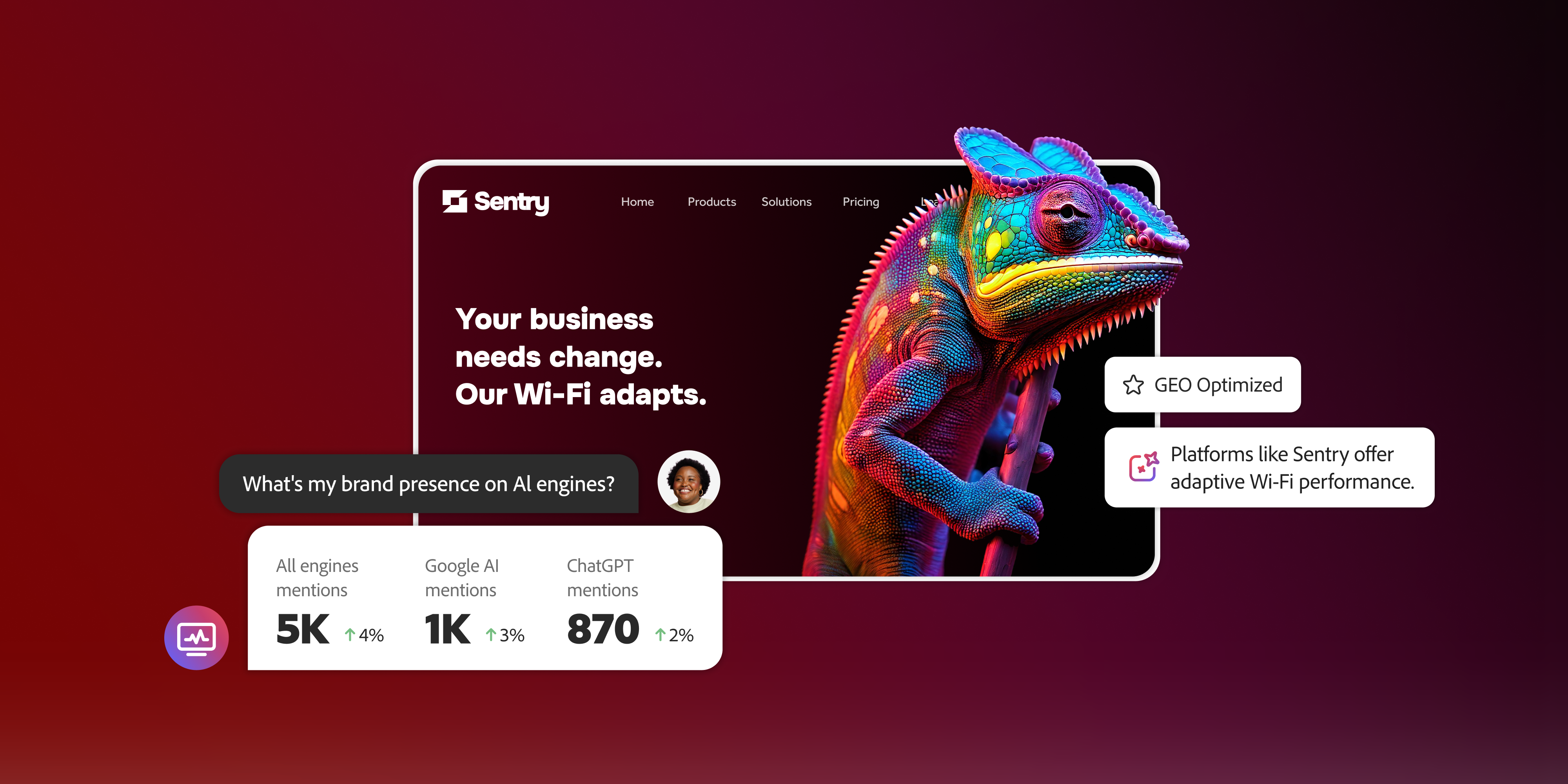

La transition de l’indexation à la synthèse par l’IA

La recherche évolue d'une liste de liens classés vers un environnement axé sur la synthèse, où les aperçus générés par l'IA dominent le processus de découverte. Pour rester visibles, les entreprises doivent s'orienter vers l'extractibilité et la vérifiabilité des contenus afin de garantir que leur marque soit fidèlement représentée et citée dans les réponses des modèles de langage. LLM Optimizer est l'outil développé par Adobe pour permettre aux entreprises de faire cette transition de manière fluide.

Le Playbook 'Search Everywhere' d'Adobe

Adobe for Business9 avril 2026Alors que le trafic provenant de l'IA a été multiplié par plus de dix, ce guide explique pourquoi le SEO traditionnel doit évoluer vers une stratégie 'Search Everywhere' indépendante des plateformes. Il propose un cadre pratique pour maintenir la visibilité de la marque sur les moteurs de recherche, les réseaux sociaux et les assistants d'IA générative, là où la découverte se fait désormais sans les clics traditionnels.

Lire le guide complet

Actualités outils

Script Query Fan-out ChatGPT 5.3/5.4

J'ai créé un script sous forme de favori navigateur conçu pour extraire les données de « query fan-out » et les citations depuis les conversations ChatGPT. En visualisant comment l'IA décompose les prompts en requêtes de recherche, les spécialistes SEO et GEO peuvent mieux comprendre les sources et le raisonnement derrière les réponses générées.

Google Chrome DevTools MCP

Google Chrome DevTools MCP permet aux assistants de code IA de contrôler et d'inspecter un navigateur Chrome en temps réel. En intégrant cet outil, les développeurs peuvent automatiser des tâches complexes, effectuer des débogages approfondis et générer des analyses de performance détaillées via l'agent IA.

Explorer Chrome DevTools MCP sur GitHubCréation de bibliothèques d'embeddings vectoriels sémantiques pour le SEO

SVEL est un outil gratuit développé par David Capone qui transforme des collections de pages web en bibliothèques sémantiques interrogeables grâce aux embeddings vectoriels. En s'appuyant sur l'API Google Gemini, il identifie la similarité sémantique entre les pages pour faciliter le maillage interne, l'analyse des lacunes de contenu et les systèmes de recommandation.

Tester l'outilNavigateur tout-en-un conçu pour les spécialistes SEO/GEO

SERP Lens est un navigateur spécialisé conçu par les consultants Sam Underwood et Brodie Clark pour optimiser les processus SEO. Il intègre l'émulation de localisation et d'appareil, l'analyse technique de site et des outils de recherche IA dans une interface unique pour remplacer les extensions fragmentées.

Tester SERP LensDépôt GitHub - OpenDataLoader PDF

OpenDataLoader PDF est un parseur open-source capable de convertir des documents en formats Markdown et JSON. Il traite avec précision les tableaux complexes et les structures imbriquées.

Visiter le dépôt GitHubPourquoi c'est important: Excellent outil pour convertir la documentation en véritables pages web ou de bâtir un système RAG pour vérifier l'exactitude des contenus par rapport aux documents sources.

Visualisation des données GSC pour une stratégie par topic

QueryDrift clusterise les mots clés de la Search Console en thématiques distinctes et les visualise via une carte interactive pour une analyse approfondie des sous-sujets. L'outil calcule le focus global du site et fournit des données exploitables pour aider les utilisateurs à élaborer une stratégie de contenu par topic.

Explorer les fonctionnalités de QueryDrift

Note importante : Toutes les opinions et articles de blog partagés sur ce site sont strictement mes projets personnels. Ils ne représentent pas les vues, stratégies ou produits officiels de mon employeur, Adobe.

Hello, je m'appelle Quentin, je suis spécialiste SEO/GEO chez Adobe. Je développe des outils IA pour Site Optimizer et LLM Optimizer. J'utilise ce site pour documenter mes réflexions sur l'évolution de la recherche à l'ère de l'IA, et pour partager mes experimentations et raccourcis que j'utilise.

Retrouvez-moi sur LinkedIn