Actualités SEO, GEO & IA : 23 mars – 5 avril 2026

Résumé IA

Cet article présente le nouveau format récurrent de revue de presse de Quentin Yacoub, conçu pour suivre les dernières évolutions de l'industrie concernant le SEO, le GEO et l'automatisation par l'IA. Les lecteurs peuvent s'attendre à une sélection pointue d'articles très pertinents et d'analyses stratégiques axées sur les workflows pratiques d'automatisation et l'évolution continue du paysage de la recherche.

Table des matières

This article is also available in English: SEO, GEO & AI News: March 23rd – April 5th, 2026

C’est la première édition de mon nouveau format conçu pour suivre les dernières évolutions de l’industrie. Je publierai ce format chaque semaine lorsque l’actualité sera aussi dense que cette édition, ou toutes les deux semaines sinon. Dans ce format, je partagerai les articles, posts LinkedIn ou X que je trouve les plus pertinents pour la stratégie SEO/GEO et l’automatisation par l’IA.

J’aimerais avoir vos retours sur le format et la mise en page, alors retrouvez moi sur LinkedIn.

Actualités SEO

Votre stratégie GEO pourrait détruire votre SEO

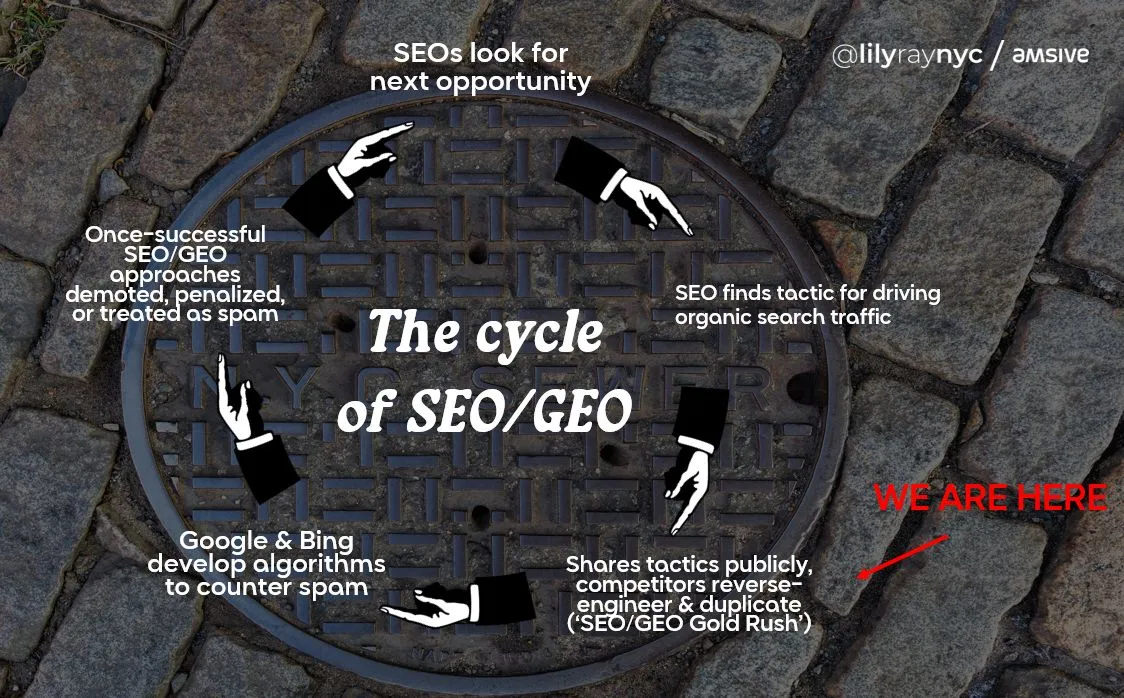

Lily Ray, consultante SEO, détaille comment les astuces GEO populaires peuvent faire chuter les positions organiques dont dépend la recherche par IA. Puisque les LLM utilisent les moteurs de recherche pour trouver des sources (RAG), perdre des positions signifie également disparaître des réponses générées par l'IA. Elle met en évidence cinq risques majeurs : le spam de contenu par IA, les fausses dates de dernière mise à jour, les top x marques/produits complaisants, les boutons d'injection de prompt et les pages de comparaison produites en masse. Mon avis : N'échange pas tes fondations organiques à long terme contre un pic de visibilité éphémère de 3 mois lié à la hype de l'IA. La majorité du trafic reste générée par la recherche classique, et les LLM ont besoin de ces classements pour te trouver en premier lieu.

Google déploie la Spam Update de mars 2026

Google vient de déployer sa première mise à jour anti-spam de l'année. Étonnamment, elle s'est terminée en moins de 24 heures. Bien que Google la qualifie de mise à jour standard, celles-ci ciblent généralement les violations de règles telles que le contenu généré par l'IA à grande échelle et les abus de liens. Je surveille actuellement les données pour voir ce qui bouge.

Lire l'article complet (non traduit)Google débute la Core Update de mars 2026

Google a débuté une Core Update le 27 mars, une refonte globale qui prendra environ deux semaines pour se terminer. Arrivant juste après la récente mise à jour anti-spam, il est encore trop tôt pour évaluer l'impact total sur les résultats de recherche. Cependant, Lily Ray a déjà signalé sur X que plusieurs sites observent des baisses significatives de leurs positions.

Lire l'article complet (non traduit)Limite de crawl de 2 Mo de Googlebot pour le HTML

Gary Illyes, analyste chez Google, explique que Googlebot arrête d'explorer un fichier HTML une fois qu'il atteint une limite de 2 Mo, ignorant tous les octets suivants. Cela me semble logique ; l'exploration du web nécessite des ressources et de l'énergie considérables, et cela incite clairement les développeurs à optimiser leur code.

Lire plusPourquoi c'est important: En tant que spécialiste SEO, l'indexation est une préoccupation majeure. Nous devrions vérifier si les pages que nous gérons dépassent 2 Mo et trouver des moyens de les alléger si c'est le cas. Pour être honnête, 2 Mo est un seuil très élevé pour du HTML. Je serais surpris de trouver beaucoup de pages au-dessus de cette limite, mais on ne sait jamais, donc cela vaut la peine de vérifier au cas où. Dans la section outils, j'ai inclus un site web pour vérifier rapidement si une page dépasse les 2 Mo.

Google ajoute la propriété digitalSourceType aux sections forum et Q&A

Google Search Central24 mars 2026Google a mis à jour ses directives de données structurées pour les questions-réponses (Q&A) et les forums de discussion afin d'inclure la propriété digitalSourceType. Cela permet aux sites d'étiqueter explicitement le contenu comme étant humain, généré par l'IA ou un hybride des deux, afin de fournir plus de clarté aux systèmes d'ingestion de Google.

Lire la documentationPourquoi c'est important: J'ai vu de nombreuses nouvelles fonctionnalités comme des encarts de résumé d'avis ou des FAQ automatisées. Selon Google, il est désormais de bonne pratique de mentionner ce qui est généré par l'IA. Personnellement, je n'y vois pas d'intérêt immédiat et je ne le ferai pas pour l'instant, mais c'est un point à noter.

Actualités GEO

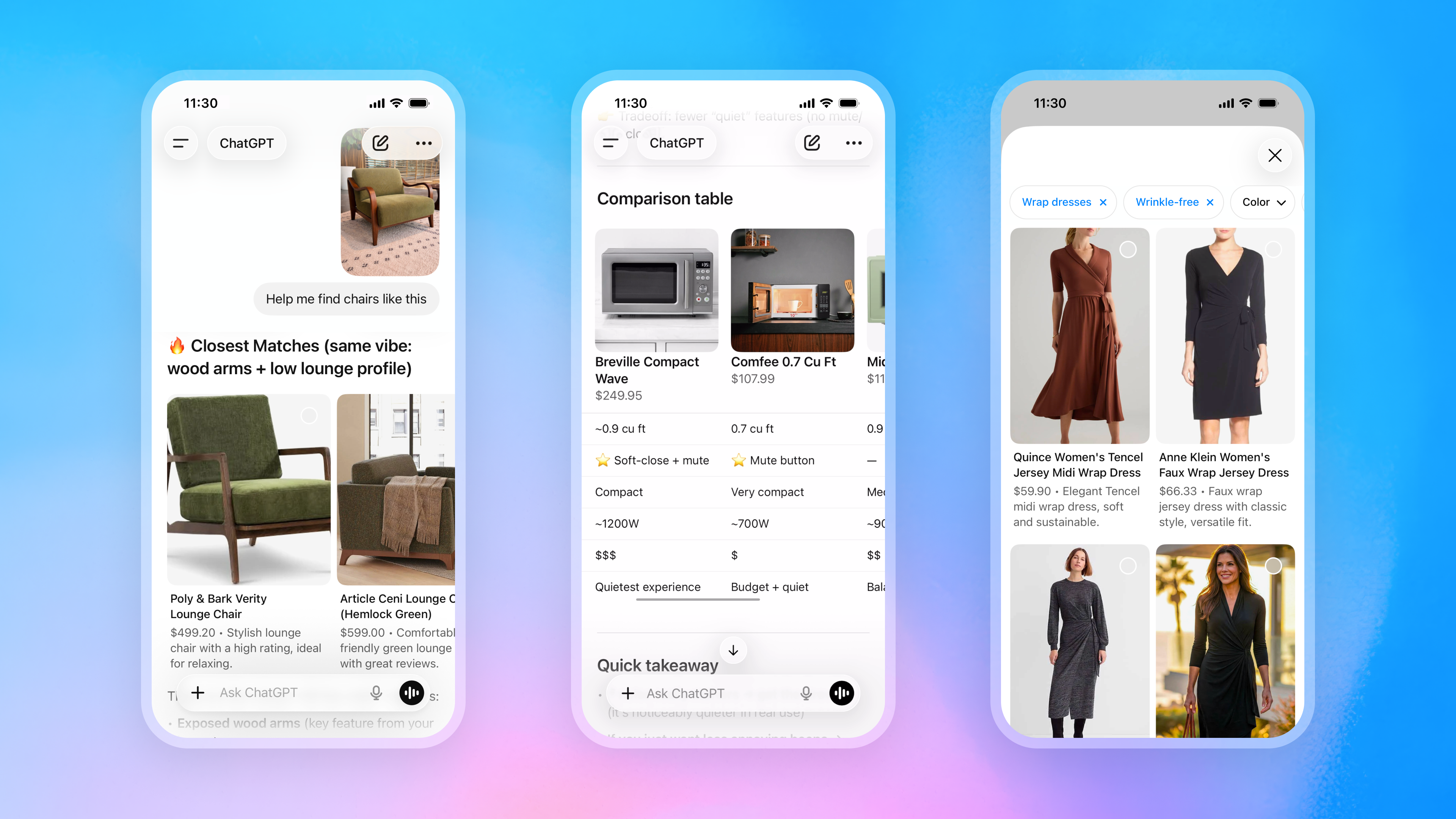

OpenAI réoriente sa stratégie de commerce agentique

OpenAI réduit la voilure sur son modèle Instant Checkout au profit de parcours de conversion appartenant aux marchands. En recentrant son Agentic Commerce Protocol (ACP), ChatGPT facilite désormais la découverte visuelle de produits et les comparaisons côte à côte en intégrant des flux de données directs provenant des marchands.

Pourquoi c'est important: 1. Ce pivot nous rappelle que nos propres sites web restent nos atouts les plus importants en 2026. 2. Traiter OpenAI comme Google en lui fournissant un flux marchand est un raccourci direct pour augmenter sa visibilité au sein de ChatGPT.

Walmart abandonne l'Instant Checkout de ChatGPT

Le projet pilote de Walmart concernant l'Instant Checkout d'OpenAI s'est soldé par des taux de conversion trois fois inférieurs à ceux des achats traditionnels sur leur site web. Daniel Danker, vice-président exécutif des produits et du design chez Walmart, a qualifié l'expérience d'insatisfaisante, ce qui a conduit le détaillant à se tourner vers son propre modèle de chatbot intégré, 'Sparky'.

Lire l'article complet (non traduit)La fin de la stratégie GEO des top x marques/produits ?

Chris Long28 mars 2026Chris Long, co-fondateur de Nectiv, décrit comment GPT 5.4 a affiné son processus query fan-out en explorant beaucoup plus de sources et en utilisant des opérateurs site: pour vérifier directement les caractéristiques des marques. Cela permet de contourner les listes tiers au profit des données primaires de la marque et d'agrégateurs de confiance comme G2 ou des lauréats de prix de l'industrie.

Lire le post LinkedIn complet (non traduit)Pourquoi c'est important: Ce changement est la première tentative significative de ChatGPT pour réduire l'impact des tactiques de manipulation. Cela a un impact direct sur le GEO, car influencer les LLM par le biais de sites de comparaison intermédiaires devient moins efficace que de maintenir de forts signaux d'autorité et des données de confiance sur son propre domaine.

Identifier les actions d'IA déclenchées par l'utilisateur avec Google-Agent

Google a ajouté un nouveau robot d'exploration déclenché par l'utilisateur, Google-Agent, à sa documentation pour identifier les agents IA effectuant des actions spécifiques comme naviguer sur des sites ou remplir des formulaires au nom des utilisateurs. J'ai hâte de voir cela dans nos tableaux de bord de trafic agentique sur LLM Optimizer pour mieux comprendre ce que ces agents recherchent et m'assurer qu'ils ne sont pas bloqués lors de leur parcours.

Lire la documentationLes risques du cloaking pour les agents IA

QueryBurst19 février 2026David McSweeney décrit comment la fonctionnalité Markdown for Agents de Cloudflare (non traduit) rend le cloaking web trivial en permettant aux sites de servir un contenu trompeur et empoisonné aux agents, tandis que les humains voient une version propre. À mon avis, les crawlers IA deviendront un jour aussi intelligents que ceux de Google et pénaliseront cette pratique lorsqu'ils reconnaîtront la disparité entre ces deux représentations de la réalité. Cependant, comme de nombreux crawlers LLM ne peuvent toujours pas exécuter le JavaScript, cette fonctionnalité reste utile pour les sites web qui dépendent fortement du rendu côté client (CSR).

Lire le test complet (non traduit)Pipelines d'extraction LLM et analyse HTML

QueryBurst13 février 2026Dans un autre excellent article de blog, David McSweeney a testé comment les agents LLM utilisent des pipelines d'extraction pour analyser les données plutôt que de lire directement le HTML brut. Il soutient que le cloaking des pages pour les crawlers LLM est largement inefficace car ces modèles reçoivent déjà un contexte nettoyé via des couches d'analyse (parsing) standard.

Lire le test complet (non traduit)Pourquoi c'est important: 1. Je comprends mieux pourquoi servir du markdown aux crawlers IA n'améliore pas nécessairement les performances. 2. Cette observation m'a poussé à commencer à pre-parse le HTML dans mes propres outils pour réduire la consommation de tokens et améliorer les performances du modèle.

Étude de Writesonic sur la façon dont les LLM explorent et extraient le contenu

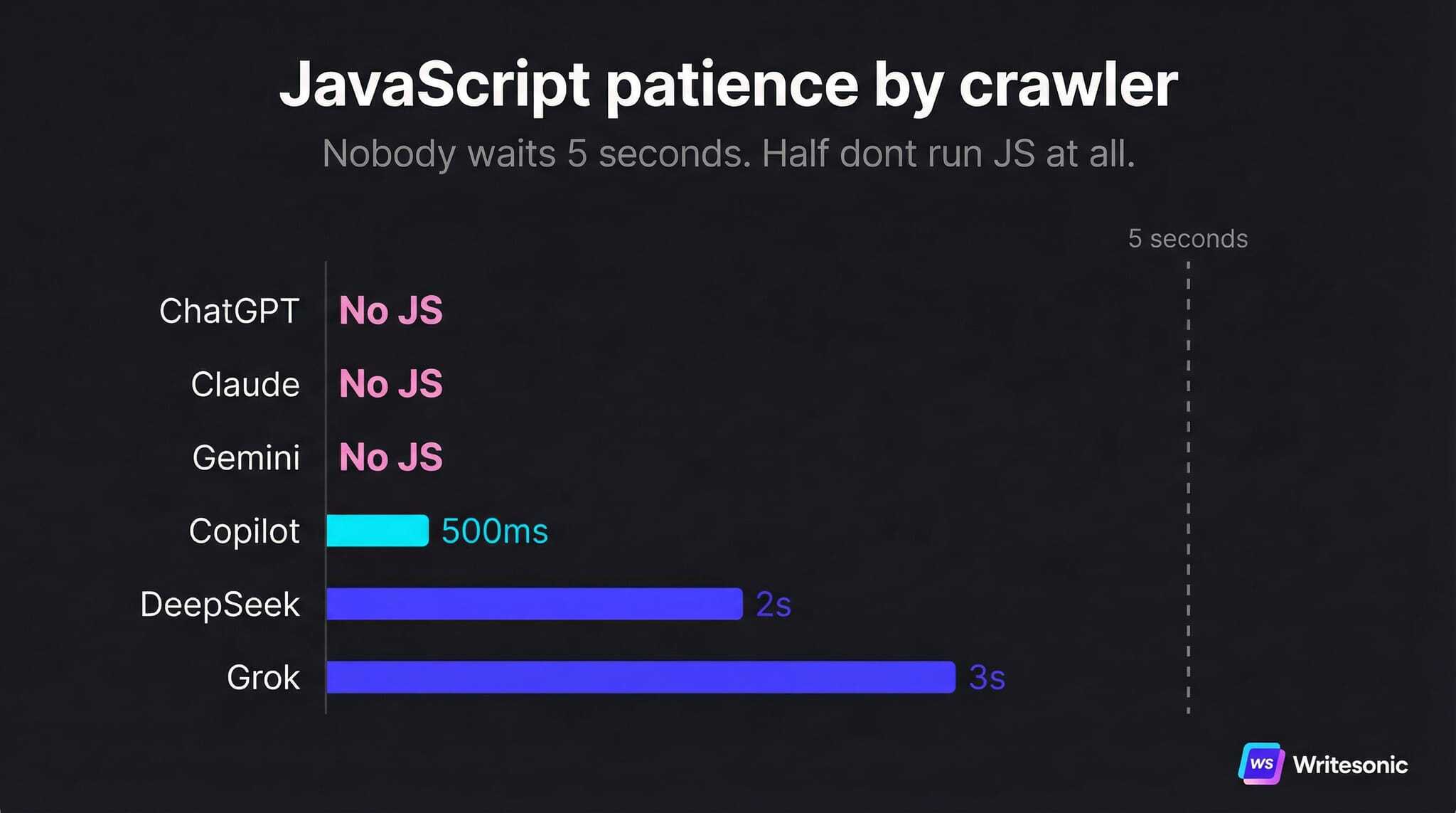

Writesonic30 mars 202610 minWritesonic a mené un test en créant une page avec 62 codes cachés pour voir ce que les LLM rapporteraient. En résumé, ChatGPT, Claude et Gemini n'exécutent pas le JavaScript, tandis que le JSON-LD, les meta descriptions et les balises OG sont supprimés dans le pipeline d'extraction.

Lire l'étude complète (non traduit)Pourquoi c'est important: 1. Les données structurées (SD) ne sont peut-être pas directement ingérées par les LLM, mais je reste convaincu qu'elles créent une boucle de visibilité indirecte. Les LLM utilisent l'expansion de requêtes (query fan-out) et le RAG pour ancrer leurs réponses dans les recherches web ; comme les moteurs de recherche s'appuient sur les données structurées pour catégoriser et classer le contenu, un balisage optimisé augmente les chances que le site soit sélectionné comme citation. Je mènerai mon propre test approfondi dans les semaines à venir pour valider cette corrélation. 2. Si votre site web s'appuie sur le rendu côté client (CSR) et que vous ne voulez pas servir une page blanche aux principaux LLM, le HTML pré-rendu est non négociable.

Actualités Adobe

Le marketing ciblant les audiences agentiques

Rachel Thornton, CMO d'Adobe entreprise, décrit comment les agents IA, en tant que nouvelle audience, nécessitent des données de marque structurées pour comprendre l'intention agentique. En tant que spécialiste SEO/GEO, je suis entièrement d'accord. Cela reflète le travail que nous faisons chez LLM Optimizer : aider les entreprises à faire la transition vers cette nouvelle réalité.

Actualités outils

EmDash : le nouveau CMS de Cloudflare

Cloudflare a lancé EmDash, un nouveau CMS construit sur le framework Astro et positionné comme le successeur spirituel de WordPress. Il propose un processus de migration fluide qui vous permet de déplacer instantanément un site entier via des fichiers WXR ou un exportateur dédié. Ayant construit mon propre blog avec Astro, je me porte garant des performances et de la personnalisation incroyables qu'il offre ; voir cette même base au cœur d'EmDash bénéficiant en plus de l'écosystème Cloudflare en fait un concurrent sérieux.

Audit SEO avec Claude Code Skills

Cet article décrit 9 SEO Skills open source développées par Agrici Daniel pour gérer les audits techniques et l'optimisation de la recherche par l'IA. Bien que ces capacités soient souvent difficiles à scale sur des sites massifs ou un portefeuille entier, elles offrent un moyen puissant d'auditer des projets plus modestes.

Lire l'article complet (non traduit)Outil gratuit Reverse Prompter

Dan Petrovic a publié un nouvel outil GEO gratuit appelé Reverse Prompting, conçu pour identifier les prompts potentiels pour une page spécifique ou à partir d'une réponse LLM. C'est une excellente ressource lorsque vous souhaitez suivre la visibilité LLM mais que vous ne savez pas par où commencer. Chez LLM Optimizer, nous fournissons également des prompts à nos utilisateurs en nous basant sur plusieurs méthodes et il est toujours intéressant de voir d'autres approches pour atteindre cet objectif.

Tester le reverse prompterVérificateur gratuit de limite de crawl de 2 Mo

Will It CrawlWill It Crawl est un outil gratuit permettant de vérifier rapidement si une page dépasse la limite de 2 Mo fixée par Googlebot. Vous pouvez trouver plus de détails sur cette limite dans la section SEO. Pour ceux qui cherchent à auditer des pages en masse, Screaming Frog fournit également ces données dans l'onglet de validation en filtrant par HTML Document Over 2MB pour identifier les risques d'indexation, et c'est gratuit jusqu'à 500 URL.

Tester le vérificateur de limite de 2 MoDépôt GitHub avec plus de 30 compétences marketing

Corey HainesCorey Haines a publié une bibliothèque open source sur GitHub comprenant plus de 30 compétences marketing spécialisées conçues pour les agents IA comme Claude Code. J'ai envie de tester les outils SEO pour les données structurées et les audits, les skills en médias payants pour la création publicitaire, et la suite CRO pour optimiser les formulaires d'inscription et les pop-ups.

Aller sur le dépôt GitHubAhrefs tease Agent A

Ryan Law, directeur du marketing de contenu chez Ahrefs, a teasé la sortie prochaine d'Agent A, une nouvelle suite d'outils conçue pour l'optimisation du contenu. J'ai hâte de voir les performances d'Agent A et de comparer ses capacités avec notre propre travail à AEM Sites Optimizer !

Lire l'un de ses posts (non traduit)

Note importante : Toutes les opinions et articles de blog partagés sur ce site sont strictement mes projets personnels. Ils ne représentent pas les vues, stratégies ou produits officiels de mon employeur, Adobe.

Hello, je m'appelle Quentin, je suis spécialiste SEO/GEO chez Adobe. Je développe des outils IA pour Site Optimizer et LLM Optimizer. J'utilise ce site pour documenter mes réflexions sur l'évolution de la recherche à l'ère de l'IA, et pour partager mes experimentations et raccourcis que j'utilise.

Retrouvez-moi sur LinkedIn